최근 AI 에이전트가 빠르게 확산하고 있습니다.

그중 OpenClaw는 2026년 들어 GitHub 스타가 가장 빠르게 늘고 있는 오픈소스 프로젝트 중 하나입니다.

얼마전 구입한 Mac mini 대상 OpenClaw 설치 전 과정을 정리해 보았습니다.

목 차

- 사전 준비

- OpenClaw 설치

- 모델 연결 — GitHub Copilot

- 텔레그램 연동

- 추가 모델 연결 — Google Gemini, OpenAI GPT

- 로컬 모델 설치

- 향후 계획 및 느낀점

사전 준비

OpenClaw는 Node.js 기반으로 동작하고, Homebrew로 필수 도구를 한 번에 설치합니다.

brew install node git gh

사실 처음에는 npm 패키지를 설치할 때 습관적으로 sudo를 붙이는 바람에 npm 캐시 권한이 좀 꼬였고, 그것 때문에 업데이트 시 캐시 권한 관련 에러로 좀 고생을 하였습니다. 아래와 같이 처음부터 캐시 경로를 옮겨두는 것이 좋습니다.

mkdir -p ~/.npm-global

npm config set prefix ~/.npm-global

echo 'export PATH=~/.npm-global/bin:$PATH' >> ~/.zshrc

source ~/.zshrc

GitHub CLI도 미리 로그인해 둡니다.

gh auth login

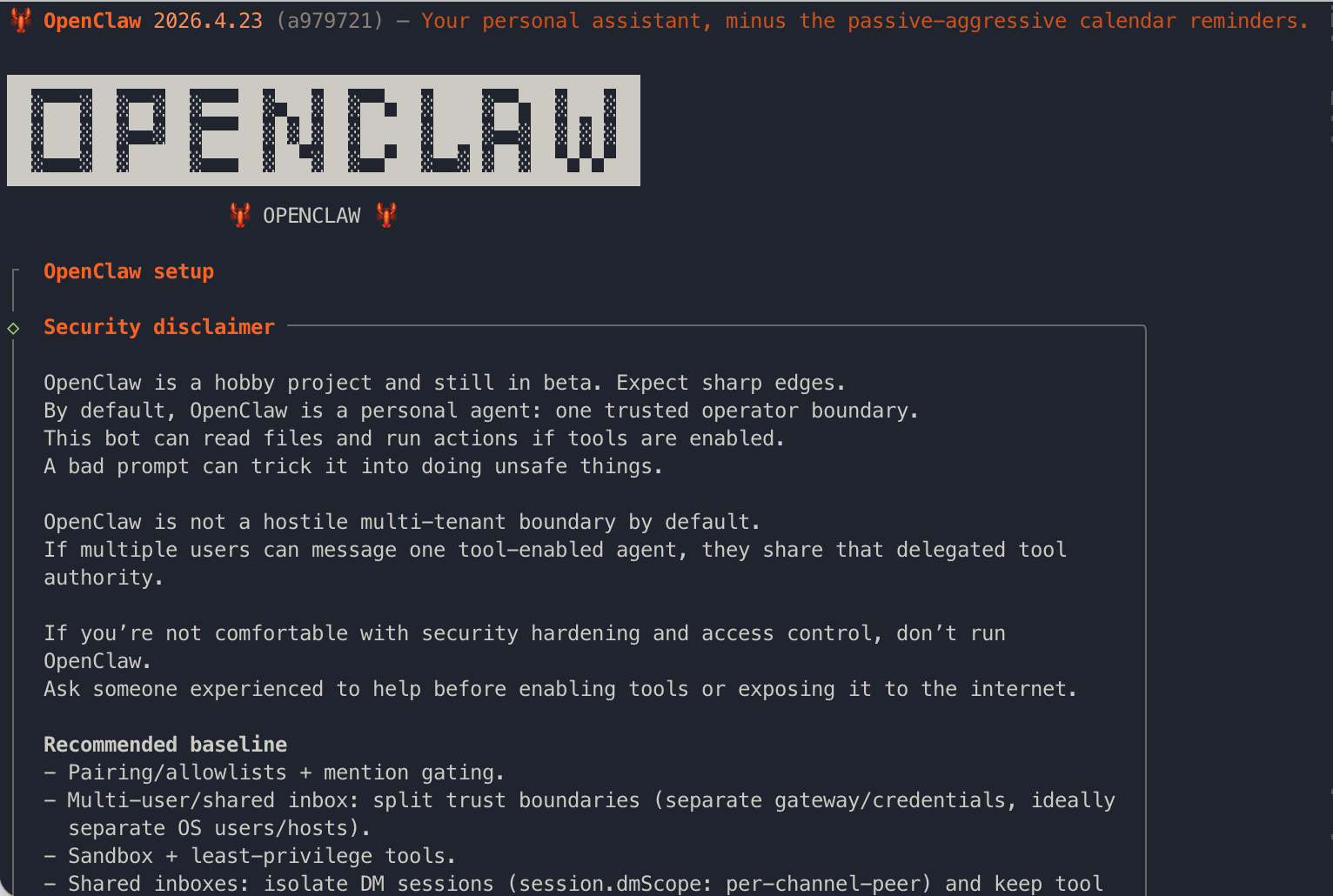

OpenClaw 설치

설치 자체는 간단합니다.

npm install -g openclaw@latest

openclaw onboard

온보딩 과정에서 다음와 같이 선택했습니다.

- Mode: Standard (대시보드 포함)

- Setup: QuickStart (검증된 기본 설정)

- Hatch: Hatch in TUI (터미널 UI에서 즉시 검증)

설치가 끝나면 OpenClaw 게이트웨이가 백그라운드에서 실행됩니다. 아래와 같이 상태를 확인할 수 있습니다.

openclaw gateway status

running (pid ...)이 표시되면 정상입니다.

브라우저로 http://127.0.0.1:18789/에 접속하면 대시보드도 사용할 수 있습니다.

모델 연결 — GitHub Copilot

최초 OpenClaw설정을 계획할때는 당연히 Claude를 이용하려고 했습니다. 그런데, 2024년 4월 Anthropic에서 OpenClaw 같은 외부도구의 구독 연동을 차단하면서 모델 선택이 고민이 되었습니다.

그래서 일단 동작 확인을 위해서 GitHub Copilot 통해서 모델을 붙여보기로 했습니다. 다행히 무료사용자에게도 제한적으로 모델 접근이 허용되어서, 임시로 사용하기에는 문제가 없었습니다.

openclaw models auth login --provider github-copilot

다만 Copilot 무료 플랜은 사용 가능한 모델이 경량 모델로 제한됩니다.

2026년 4월 기준으로 claude-haiku-4.5, gpt-5-mini, raptor-mini (Preview) 정도입니다.

~/.openclaw/openclaw.json 파일의 agents.defaults.models에 사용할 모델을 등록합니다.

"models": {

"github-copilot/claude-haiku-4.5": {},

"github-copilot/gpt-5-mini": {}

}

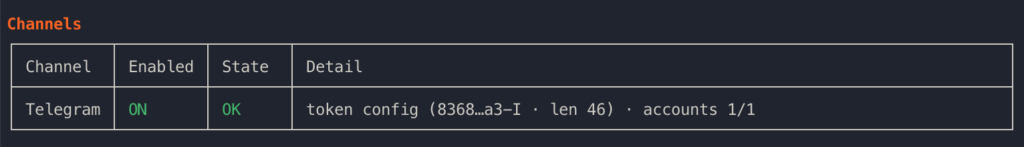

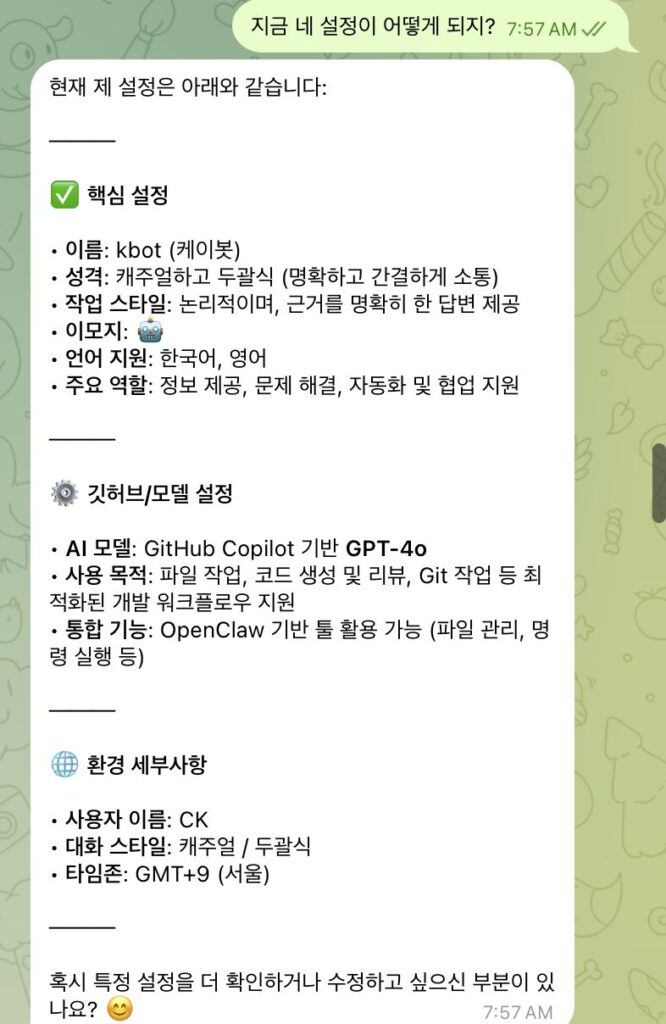

텔레그램 연동

OpenClaw 인기의 주요 이유중의 하나가 텔레그램 연동입니다. 집안의 Mac mini에서 실행중인 OpenClaw를 텔레그램 메시지를 통해서 집밖에서 자유롭게 이용할 수 있게 됩니다.

텔레그램에서 @BotFather를 검색해 /newbot 명령으로 봇을 만들면 새로운 봇을 만들수 있고, 봇토큰도 발급됩니다.

이 토큰은 평문 문자열이므로 노출 시 즉시 /revoke로 재발급해야 합니다.

이후 아래와 같이 플러그인을 먼저 설치한 후에, 봇토큰을 등록합니다.

openclaw plugins install telegram

"channels": {

"telegram": {

"enabled": true,

"botToken": "<YOUR_BOT_TOKEN>",

"groups": {

"*": {

"requireMention": true

}

}

}

}

requireMention: true는 그룹 채팅에서 봇을 멘션해야만 응답하는 안전장치입니다. 다른 사람의 메시지에 봇이 자동 응답하지 않도록 합니다.

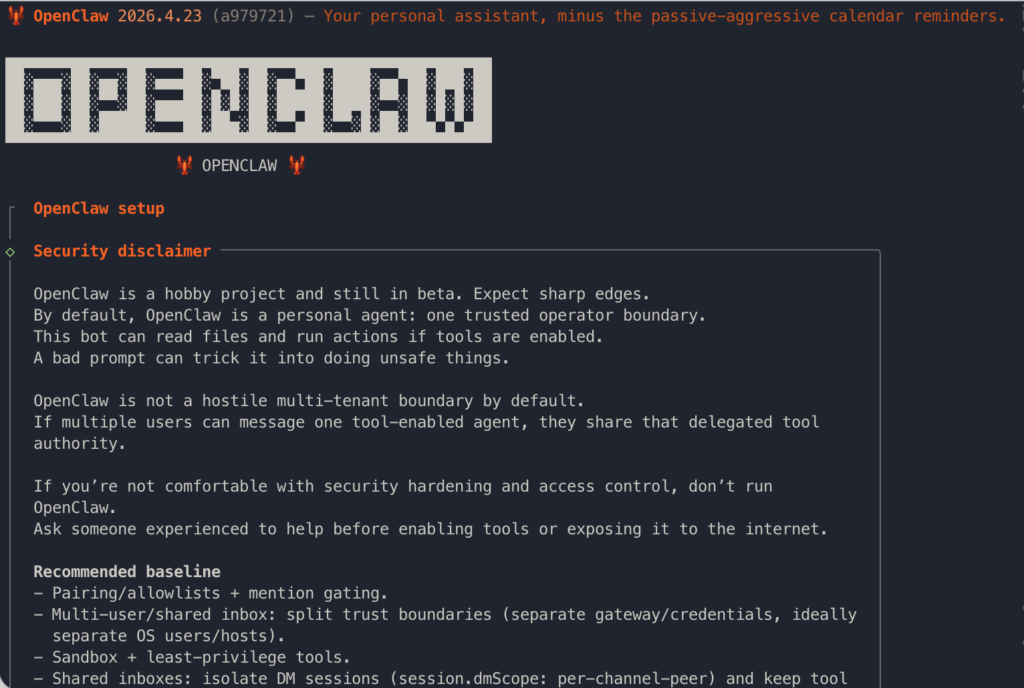

게이트웨이를 재시작하고 채널 상태를 확인합니다.

openclaw gateway restart

openclaw channels status

아래와 같이 성공적으로 첫 대화를 마쳤습니다.

추가 모델 연결 — Google Gemini, OpenAI GPT

Copilot 무료 플랜을 계속사용할 수는 없어서, 다른 모델을 추가로 연결해 주어야 합니다.

1) Gemini 무료 티어 추가

구글 Gemini도 구글 AI Studio에서 API키를 발급 받으면 일부 모델을 무료로 이용할 수 있습니다.

참고로, Google AI Pro 구독을 이용 중이지만 OpenClaw 연동에는 별도 API 키가 필요합니다. Google AI Pro 구독은 Gemini 앱/웹 사용권일 뿐 API 접근권이 아닙니다. 다행히 API 키 자체는 무료로 발급됩니다.

https://aistudio.google.com/apikey에서 키를 발급받아 환경변수에 등록합니다.

echo 'export GEMINI_API_KEY="AIzaSy..."' >> ~/.zshrc

source ~/.zshrc

OpenClaw가 설정에서 환경변수를 자동으로 감지하여 모델을 추가할 수 있습니다.

다만 무료 사용량이 예상보다 너무 적어서, 적극적 활용은 어려울듯 합니다.

| 모델 | RPM (Req per min) | TPM (Tokens per min) | RPD (Req per day) |

| Gemini 2.5 Flash | 0 / 5 | 0 / 250K | 0 / 20 |

| Gemini 3 Flash | 0 / 5 | 0 / 250K | 0 / 20 |

| Gemini 2.5 Flash Lite | 0 / 10 | 0 / 250K | 0 / 20 |

| Gemini 3.1 Flash Lite | 0 / 15 | 0 / 250K | 0 / 500 |

2) ChatGPT 구독 연결

모델 정보를 확인하다 보니OpenAI는 Anthropic과 달리 ChatGPT 구독에 대해 OAuth를 공식 지원합니다. 다시 말해, ChatGPT 구독자라면 추가 비용 없이 Codex 모델을 OpenClaw에서 사용할 수 있다는 의미입니다.

openclaw models auth login --provider openai-codex

위 명령을 실행하면 브라우저를 통해 ChatGPT 계정으로 로그인 후 사용 인증을 할 수 있습니다.

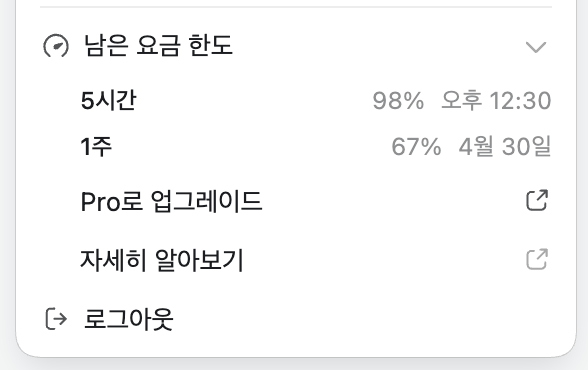

이를 통해 gpt-5.4 나 최근 발표된 gpt-5.5 도 이용가능합니다. 다만 ChatGPT 구독 플랜에 따라 사용 한도가 있어, 사용 계획을 잘 수립할 필요가 있습니다. 참고로, 남은 사용 한도는 Codex 앱 설정창에서 확인 가능합니다.

로컬 모델 설치

Mac mini를 구매한 이유중의 하나가 로컬 모델 운영입니다. 클라우드 모델 사용량의 압박에서 자유로울 수 있고, 개인정보 관련 된 부분에서도 안심하고 활용이 가능하죠.

확인 결과, Apple Silicon + 32GB RAM이면 중소형급 로컬 모델을 안정적으로 돌릴 수 있을것 같았습니다.

로컬 모델 서빙을 위해 Ollama를 설치합니다.

brew install ollama

brew services start ollama

미리 경험한 동료 추천 및 후기를 바탕으로 Gemma4:e4b 와 Gemma4:26b 모델을 다운 받아서 테스트를 해 보았습니다.

ollama pull gemma4:e4b

ollama pull gemma4:26b

32GB RAM 환경에서 e4b는 메모리 부담 없이 빠르게 응답한 반면, 26b는 응답 품질이 더 좋았지만 실행 시 메모리를 거의 모두 점유했습니다. 어떤 모델을 주력으로 사용할지, 아님 다른 로컬 모델로 변경할 지는 추후 더 사용해 보면서 결정할 예정입니다.

현재는 로컬 모델들은 메인 모델이 아니라 폴백(fallback) 모델로 등록해 두었고, 클라우드 모델 한도를 모두 소진하거나, 필요시에만 사용할 예정입니다. 다행히 Ollama가 모델을 호출 시점에만 메모리에 로드되고, 5분 이상 미사용 시 자동으로 메모리에서 내려간다고 합니다.

OpenClaw 설정에 등록하거나 config 명령을 통해 간단하게 이용 가능합니다.

단, 로컬 모델은 클라우드 모델보다 정확도나 응답품질이 떨어질 수 있어서, 시스템 프롬프트를 별도로 설정해 주는것이 좋다고합니다. 이 부분은 좀더 공부를 해봐야겠습니다.

향후 계획 및 느낀점

일단 이정도로 기본 설정은 마무리 하였습니다.

다음으로는 오픈클로와 대화를 통해서 바이브하게 간단한 작업들을 자동화 해 볼 예정인데요,

생각하고 있는 일들은 메일 정리, 뉴스 확인, 노션에 글쓰기 정도 입니다. 이 부분은 다음 글에서 다루도록 하겠습니다.

설치를 완료하고 좀 사용하다보니까, 기존에 ChatGPT 같은 대화형 AI만 쓰던 때와 확실히 차이가 납니다.

대화형 AI는 LLM 위에 얇은 Agent 레이어만 올라간 형태라 Agent와 Model의 구분이 모호했습니다. 반면 OpenClaw는 Agent와 Model이 명확히 분리되어 개념이 정리됩니다. Model을 미들웨어라고 본다면, Agent는 그 위에 구축된 서비스에 가깝습니다.

물론 Claude Cowork을 시작으로 다른 업체들에서도 유사한 서비스가 출시될것 같기는 한데요, 자유도 면에서는 OpenClaw가 아직은 한수 위가 아닌가 싶네요.

기존 도구들이 좀더 특화된 분야에 대한 전문성을 키워가는 쪽으로 발전중이라면, OpenClaw는 시스템 차원에서 모든 분야를 대상으로 서비스를 제공하는 쪽으로 방향을 잡고 있는 듯 합니다.

환경 구축을 완료했으니, 이제 실질적으로 사용을 좀 해보면서, 인터넷과 SNS에 돌아다니는 수많은 말들처럼 정말 OpenClaw가 만능 도구 인지, 아님 아직은 전문가의 손길이 좀 더 필요한 도구일 뿐인지 확인해 보도록 하겠습니다.

AI는 이제 도구가 아니라 시스템의 일부가 되었습니다.

ChulJoo Kim (김철주).

ckarch.kr

© 2026

is licensed under

CC BY-NC-SA 4.0